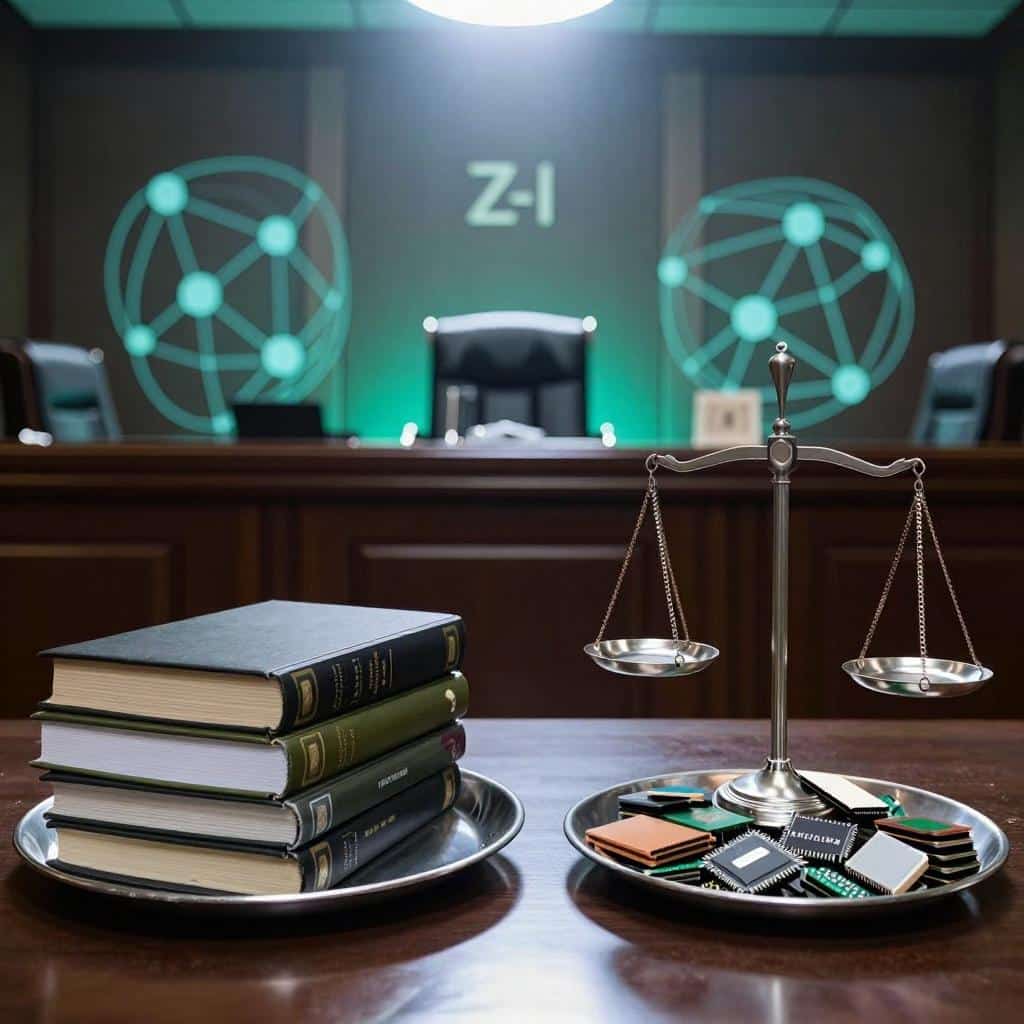

Ça chauffe entre le Pentagone et Anthropic, la seule entreprise qui tient à son image publique de fabricant d’IA sûre et éthique. Le secrétaire à la Défense américaine envisage de couper les ponts avec Anthropic et de la classer comme un risque pour la chaîne d’approvisionnement, une décision qui pourrait avoir des conséquences financières massives pour la start-up. Mais quel est le véritable enjeu ici ?

Anthropic se distingue de ses concurrents par son engagement envers une IA sûre et éthique. L’entreprise a même été jusqu’à refuser une utilisation militaire illimitée de ses systèmes d’IA. Actuellement, les modèles d’Anthropic sont les seuls outils d’IA disponibles à l’intérieur des systèmes militaires classifiés via des fournisseurs tiers comme Palantir Technologies. Cependant, ces outils sont livrés avec certaines restrictions. Les dirigeants d’Anthropic ont clairement indiqué qu’ils ne souhaitaient pas que leurs systèmes soient utilisés pour le ciblage d’armes autonomes ou la surveillance domestique.

La position d’Anthropic a été saluée par certains comme un acte de résistance éthique face à la puissance militaire. Mais cette résistance a un coût. Le Pentagone met la pression sur Anthropic et d’autres entreprises d’IA comme Google, OpenAI et xAI pour qu’elles autorisent l’utilisation de leurs modèles pour “tous les usages légaux”.

La position d’Anthropic met l’entreprise dans une situation délicate. D’un côté, elle risque de perdre un client majeur, le Pentagone, et d’autre côté, elle tient à rester fidèle à ses principes éthiques. Si le Pentagone décide de classer Anthropic comme un risque pour la chaîne d’approvisionnement, cela pourrait forcer tous les entrepreneurs cherchant à travailler avec l’armée américaine à couper les liens avec Anthropic, créant un problème financier beaucoup plus grand pour la start-up.

Le Pentagone a clairement indiqué que sa relation avec Anthropic est en cours de révision. “Notre nation exige que nos partenaires soient disposés à aider nos combattants à gagner dans n’importe quel combat”, a déclaré le porte-parole du Pentagone, Sean Parnell. Cette déclaration met en lumière le défi auquel Anthropic est confronté : comment concilier l’engagement envers une IA sûre et éthique avec les impératifs commerciaux de survie financière ?

Ce dilemme n’est pas unique à Anthropic. Toutes les entreprises d’IA doivent faire face à des questions similaires. Comment équilibrer les considérations éthiques avec les exigences commerciales ? Comment naviguer dans un paysage où les intérêts militaires et gouvernementaux peuvent entrer en conflit avec les principes éthiques ? Ce sont des questions complexes qui nécessitent une réflexion profonde et une prise de décision prudente.

La situation actuelle d’Anthropic soulève de nombreuses questions sur l’avenir de l’IA. Si le Pentagone classe Anthropic comme un risque pour la chaîne d’approvisionnement, cela pourrait avoir un effet d’entraînement sur d’autres entreprises d’IA. Elles pourraient être forcées de choisir entre respecter leurs principes éthiques et maintenir leurs relations commerciales.

Par ailleurs, le PDG d’Anthropic, Dario Amodei, a récemment mis en garde contre les risques liés à l’utilisation de l’IA par l’armée et le gouvernement. Il a souligné la nécessité d’une supervision pour protéger contre les abus potentiels de l’IA. Cette déclaration souligne la complexité des problèmes auxquels le secteur de l’IA est confronté.

La confrontation entre le Pentagone et Anthropic illustre parfaitement le défi auquel le secteur de l’IA est confronté : concilier l’éthique et les impératifs commerciaux. Il est clair que la route vers une IA sûre et éthique est semée d’embûches. Mais avec une réflexion prudente et une volonté de tenir bon, les entreprises comme Anthropic peuvent montrer la voie à suivre.

ces mini cerveaux cultivés en laboratoire ont montré une capacité impressionnante à apprendre et à s’adapter pour résoudre un défi d’ingénierie.

Tu te demandes peut-être ce qu’est un modèle d’incorporation multimodal ?

Imagine que chaque message que tu ouvres pourrait être une attaque de phishing.

Ça chauffe entre le Pentagone et Anthropic, la seule entreprise qui tient à son image publique de fabricant d’IA sûre et éthique

NVIDIA, leader mondial des technologies de l’IA, est actuellement sous le feu des projecteurs