En l’espace de quelques années, l’intelligence artificielle est passée du stade d’expérimentations confinées aux laboratoires de recherche à celui de moteur stratégique de l’économie mondiale. Les modèles génératifs, l’IA décisionnelle et les systèmes autonomes bouleversent des secteurs aussi variés que la santé, l’énergie, la défense, la finance ou encore la création artistique. Cette révolution, alimentée par une croissance exponentielle des capacités de calcul et par la disponibilité massive de données, redistribue déjà les cartes de la puissance économique et politique.

Les enjeux sont colossaux : maîtrise de la chaîne d’approvisionnement en semi-conducteurs, souveraineté numérique, contrôle des standards techniques, gestion des impacts sociétaux et anticipation des risques. Dans cette course, les grandes puissances cherchent à définir non seulement leur stratégie interne, mais aussi les règles du jeu global, conscientes que celui qui établira les normes influencera la direction même du progrès technologique.

Au sommet de cette compétition se trouvent deux pôles d’influence majeurs : les États-Unis et l’Union européenne (le vieux continent et sa protection RGPD).

Les États-Unis misent sur la rapidité, l’agilité et la primauté technologique. Leur AI Action Plan repose sur une approche minimaliste en matière de régulation, destinée à accélérer le développement et la mise sur le marché des innovations. L’objectif est clair : conserver un leadership mondial, éviter tout retard face à la Chine, et sécuriser l’accès aux ressources matérielles et logicielles critiques.

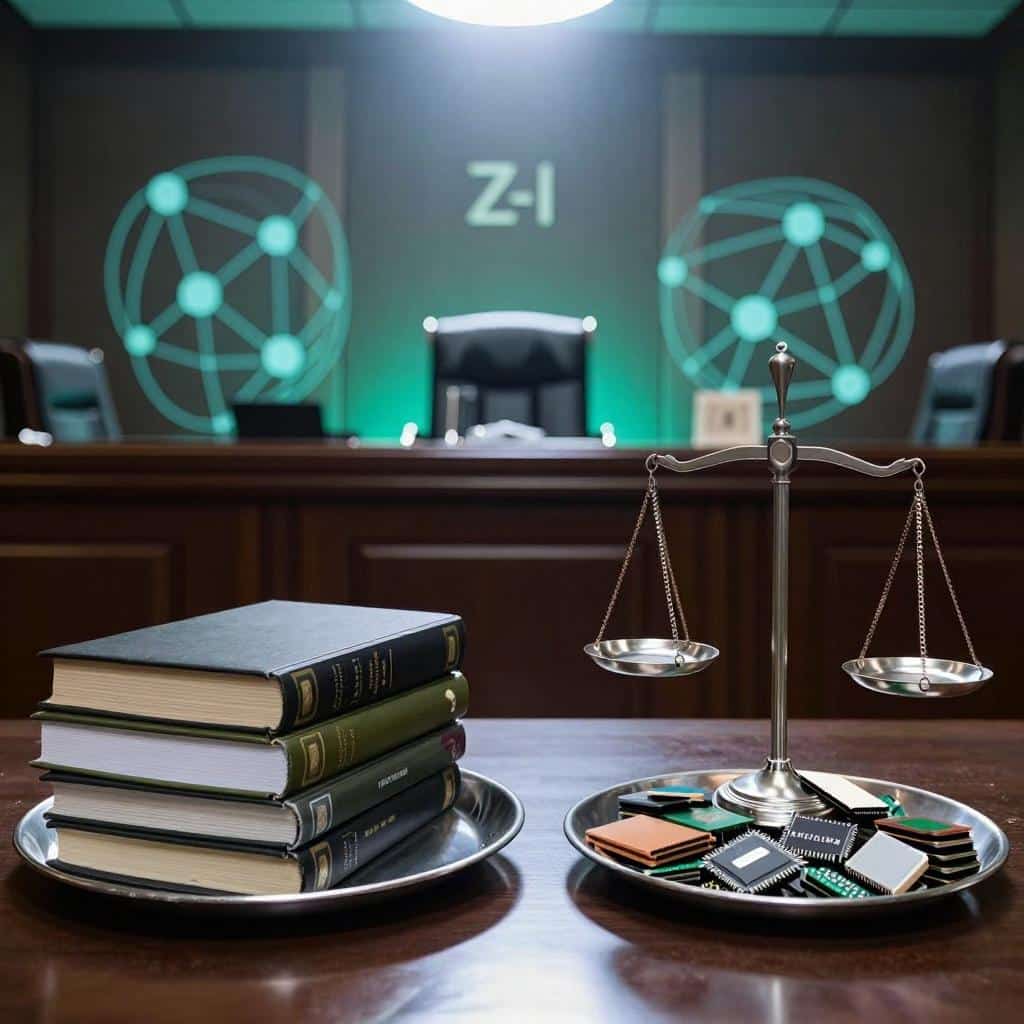

L’Union européenne, avec son AI Act, choisit la voie de la régulation structurée et progressive. L’UE cherche à instaurer un cadre de confiance qui encadre les risques, protège les droits fondamentaux et garantit une adoption éthique de l’IA. Plutôt que de privilégier la vitesse, elle mise sur la durabilité, la sécurité et l’acceptabilité sociale.

Ces deux approches reflètent des philosophies profondes : d’un côté, la conviction que la liberté d’expérimenter engendre l’innovation ; de l’autre, la certitude qu’une innovation non maîtrisée peut saper les fondations mêmes de la confiance publique.

Fin juillet 2025, l’administration américaine a dévoilé l’America’s AI Action Plan, un programme massif visant à renforcer la position dominante des États-Unis dans le domaine de l’intelligence artificielle. Ce plan, pensé comme une réponse directe à la montée en puissance de l’IA en Asie et en Europe, s’articule autour de trois priorités :

Cette stratégie assume un choix fort : privilégier la vitesse et la liberté d’action au détriment d’un encadrement strict. Les entreprises bénéficient de « regulatory sandboxes », où elles peuvent tester des solutions avant validation formelle. La suppression de références à la diversité et à l’inclusion dans les standards officiels illustre une volonté de simplifier les priorités et de concentrer l’action sur la performance technologique pure.

Le 24 juillet 2025, l’Union européenne a franchi une nouvelle étape dans l’entrée en vigueur de son AI Act, premier cadre législatif global consacré à l’intelligence artificielle. Cette régulation repose sur une classification par niveaux de risque :

L’UE introduit aussi des règles spécifiques pour les modèles d’IA à usage général (GPAI). Le Code de Conduite GPAI, publié en parallèle, fournit un guide pratique de conformité volontaire, susceptible d’alléger certaines démarches pour les acteurs qui s’y conforment.

Contrairement aux États-Unis, l’Europe choisit la voie de la prudence et de la confiance. L’objectif est de garantir que chaque usage de l’IA respecte les droits fondamentaux, protège les consommateurs et évite les risques systémiques. Ce choix implique des obligations plus lourdes pour les entreprises, mais vise à instaurer un environnement prévisible et sécurisé sur le long terme.

Du point de vue américain, l’approche européenne paraît trop lente et restrictive, au risque de freiner la compétitivité et la réactivité face aux innovations mondiales. Dans un marché en expansion rapide, la lenteur est perçue comme une perte d’opportunités économiques et stratégiques.

Du point de vue européen, la dérégulation américaine expose les citoyens à des risques majeurs : biais systémiques, atteintes à la vie privée, prolifération de deepfakes, usages malveillants. Pour l’UE, une croissance durable suppose un climat de confiance et des garde-fous robustes.

L’IA devient un levier stratégique comparable au nucléaire ou à l’espace. Les États-Unis, leaders sur le marché des GPU avec NVIDIA, limitent déjà l’exportation de certaines puces haut de gamme vers des zones concurrentes. Si l’Europe se positionnait comme rival direct, des restrictions supplémentaires pourraient émerger. L’UE serait alors contrainte d’investir massivement dans une filière locale de semi-conducteurs ou de négocier un partenariat stratégique garantissant l’accès au matériel, avec d’éventuelles contreparties politiques ou normatives.

Ces divergences peuvent fragmenter le marché mondial de l’IA. Le bloc américain capterait capitaux, talents et ressources matérielles, porté par la vitesse et le capital-risque. Le bloc européen attirerait les acteurs à la recherche de stabilité réglementaire, de protection des données et d’image éthique. Le risque pour l’Europe est de rester consommatrice de technologies américaines, limitant sa capacité à déployer des IA concurrentes à grande échelle. À l’inverse, les États-Unis pourraient subir un déficit de confiance internationale en cas de dérives trop visibles.

L’intelligence artificielle n’est plus une technologie en devenir : elle façonne déjà l’économie, la politique et la société. Mais entre l’approche américaine, rapide et orientée marché, et l’approche européenne, prudente et centrée sur la régulation, deux visions du futur s’affrontent.

Ce choix stratégique influence la manière dont les entreprises innoveront, dont les citoyens interagiront avec les machines, et dont les nations se positionneront dans la nouvelle hiérarchie mondiale. Les tensions autour de l’accès aux puces NVIDIA et d’autres ressources critiques montrent que la bataille de l’IA n’est pas qu’idéologique — elle est aussi matérielle et géopolitique.

La question centrale demeure en nos âmes et consciences européennes puisqu’il s’agit de la perspective de cet article franco-européen : voulons-nous un monde où l’IA avance plus vite que les règles, ou un monde où les règles donnent le rythme à l’IA ? La voie la plus crédible semble être un équilibre hybride : combiner l’agilité américaine et la fiabilité européenne pour éviter une fragmentation durable en écosystèmes incompatibles.

FX 14/08/2025

ces mini cerveaux cultivés en laboratoire ont montré une capacité impressionnante à apprendre et à s’adapter pour résoudre un défi d’ingénierie.

Tu te demandes peut-être ce qu’est un modèle d’incorporation multimodal ?

Imagine que chaque message que tu ouvres pourrait être une attaque de phishing.

Ça chauffe entre le Pentagone et Anthropic, la seule entreprise qui tient à son image publique de fabricant d’IA sûre et éthique

NVIDIA, leader mondial des technologies de l’IA, est actuellement sous le feu des projecteurs