Les débats sur les dérives potentielles de “GPT‑5” (visionnaire, opaque, centralisé) mettent en lumière un besoin de souveraineté numérique. Pour des organisations publiques ou entreprises françaises, utiliser une intelligence artificielle locale, modulable, transparente et adaptée à notre langue relève non seulement d’un choix technologique, mais d’une décision stratégique. C’est dans ce contexte que la montée de modèles comme Mistral ouvre de nouvelles perspectives.

Mistral AI est une jeune startup française fondée en avril 2023 à Paris par trois figures majeures de la recherche en intelligence artificielle :

En quelques mois, l’entreprise a levé plus d’un milliard d’euros de financements auprès d’investisseurs internationaux et atteint une valorisation proche de 6 milliards d’euros.

Une performance qui illustre l’intérêt stratégique de disposer d’un champion européen dans un domaine dominé par les États-Unis et la Chine.

Dès sa création, Mistral a affiché une ligne directrice claire : mettre en avant l’open source.

Contrairement à OpenAI qui restreint l’accès à ses modèles, Mistral publie ses poids et ses architectures.

Cette ouverture garantit la transparence, favorise l’audit scientifique et permet à chacun – chercheurs, entreprises, administrations – d’adapter les modèles à ses besoins.

Mais l’histoire de Mistral ne s’écrit pas uniquement à Paris.

Autour de la startup, une communauté internationale dynamique contribue chaque jour à enrichir et spécialiser les modèles :

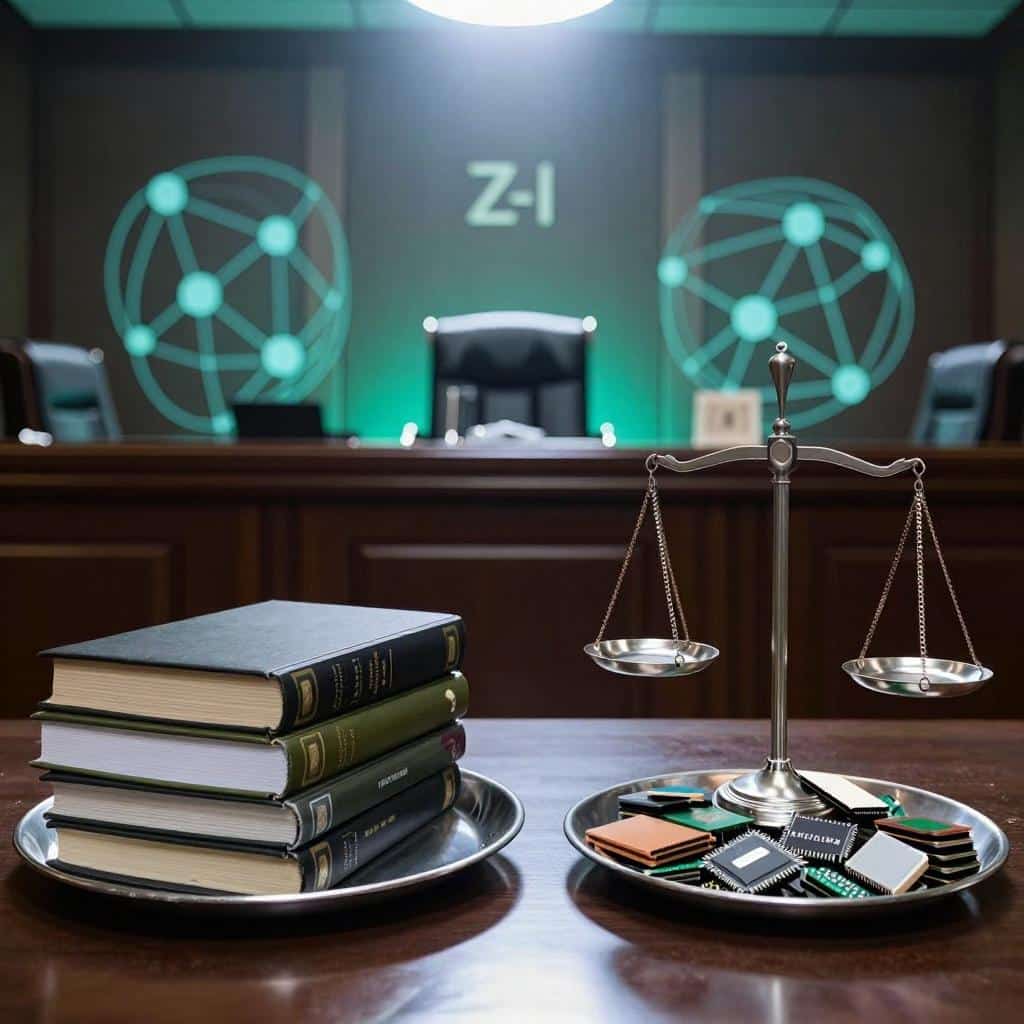

Depuis l’essor fulgurant d’OpenAI et de son modèle GPT, une question majeure s’impose : faut-il confier les usages stratégiques de l’intelligence artificielle à des boîtes noires américaines, ou privilégier des alternatives ouvertes et européennes comme Mistral ?

La comparaison entre les deux approches met en lumière des différences fondamentales :

Mistral n’est pas seulement une entreprise ou une alternative française à OpenAI : c’est devenu un écosystème collaboratif. Cette combinaison entre une équipe dirigeante visionnaire et une communauté mondiale engagée fait de Mistral un acteur incontournable de l’IA, tout en affirmant une identité européenne et francophone dans un secteur en quête d’alternatives crédibles aux géants américains.

Mistral implémenté en serveur local : c’est encore mieux (via par exemple OpenWEBUI et TGWUI) !

Au-delà des modèles officiels publiés par Mistral AI, une vaste communauté open source contribue activement à leur évolution.

Ces contributeurs – chercheurs, développeurs indépendants, institutions et passionnés – adaptent et affinent les modèles pour des usages spécifiques.

C’est ainsi qu’apparaissent des versions orientées médecine (analyse de textes cliniques, aide à la décision thérapeutique),

ou encore centrées sur la littérature (storytelling, écriture immersive). Cette diversité illustre la vitalité de l’écosystème Mistral.

Deux exemples récents montrent bien cette complémentarité :

Cette comparaison met en lumière la force du modèle open source :

les utilisateurs peuvent choisir entre un outil rationnel (Instruct) et un outil créatif (Cydonia), selon les besoins concrets de leur activité.

exemple comparatif concernant les prompt :

Evidemment, l’idée sous-jacente ici est de montrer qu’il est important de cloisonner ses données.

Dans le domaine open source médical, on pourrait citer 2 modèles locaux :

MedLLaMA-3 et MedicalEDI-8B. Dans un avenir proche (ou même le présent), certains logiciels assistants “médicaux” tirent (reront) leurs résultats de ces modèles.

Voici des exemples probants de prompts et d’une occurence de résultat de prompts, à usage de test et pédagogiques … :

1 – Pour MedLLaMA-3 (usage médical général)

But : répondre factuellement, analyser des données, expliquer des concepts médicaux.

2 -Pour MedicalEDI-8B (raisonnement clinique dialogué)

But : simuler un entretien patient–médecin, structurer le raisonnement diagnostique.

»

Exemple en local :

Autre exemple :

Cela préfigure de la médecine de demain au regard de la problématique des déserts médicaux et de la surcharge de travail pour nos médecins mais aussi pour nos étudiants, chercheurs et enseignants chercheurs.

Incroyable et simple non …. ? Icc peut vous accompagner sur Dijon et sa Région afin d’implémenter de tels dispositifs selon la règlementation sur leur usage (IA ACTE par exemple ou règles déontologiques) ou vous former à ce type de technologie (Formations Qualiopi, certification en cours).

Ainsi, face aux modèles propriétaires comme GPT-4 ou GPT-5 d’OpenAI, dont le fonctionnement reste une véritable boîte noire, l’approche de Mistral représente une alternative stratégique et souveraine pour la France et l’Europe.

En adoptant des modèles ouverts, audités et modulables, les entreprises et administrations ne dépendent plus d’infrastructures étrangères ni de services soumis aux aléas de la régulation américaine.

Utiliser Mistral en local offre plusieurs avantages concrets et durables :

Au-delà de l’efficacité technique, choisir Mistral c’est aussi affirmer une volonté politique et culturelle :

garantir une intelligence artificielle respectueuse des normes européennes, de la langue française et des besoins réels des organisations publiques et privées.

C’est pourquoi, dans un monde où la maîtrise des données est devenue un enjeu vital, Mistral serait l’alternative IA d’un allié naturel pour la souveraineté numérique.

ces mini cerveaux cultivés en laboratoire ont montré une capacité impressionnante à apprendre et à s’adapter pour résoudre un défi d’ingénierie.

Tu te demandes peut-être ce qu’est un modèle d’incorporation multimodal ?

Imagine que chaque message que tu ouvres pourrait être une attaque de phishing.

Ça chauffe entre le Pentagone et Anthropic, la seule entreprise qui tient à son image publique de fabricant d’IA sûre et éthique

NVIDIA, leader mondial des technologies de l’IA, est actuellement sous le feu des projecteurs